通过日志服务高效调试分布式系统

随着微服务与云原生架构的普及,分布式系统的复杂性与日俱增。一个简单的用户请求可能会跨越多个服务、容器和节点,传统的单机调试方法在此场景下往往力不从心。而集中式的日志服务,凭借其强大的采集、聚合、存储与检索能力,已成为调试现代分布式系统的核心工具。本文将探讨如何通过日志服务,系统性地进行分布式系统的调试与问题诊断。

一、日志服务的核心价值:从分散到统一

在分布式环境中,日志数据散落在各个服务实例、主机和容器中。日志服务(如ELK Stack、Loki、商业云日志服务等)的首要价值在于集中化管理。它通过代理(如Fluentd、Filebeat)自动采集来自不同源的日志,进行标准化处理(如解析JSON、提取关键字段、添加元数据),并存入一个可扩展的存储后端。这为工程师提供了一个全局的、统一的查询入口,使得追踪一个请求的完整生命周期成为可能。

二、调试实战:关键策略与步骤

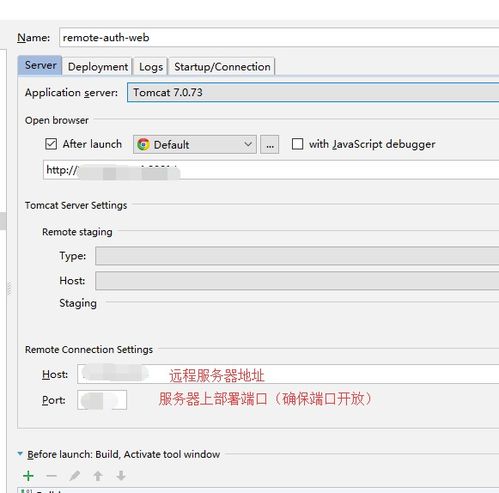

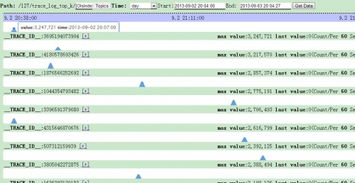

- 建立全链路追踪标识:调试的基石是能够将一次请求在所有相关服务中产生的日志关联起来。必须在请求入口(如API网关)生成一个全局唯一的Trace ID,并将其注入到后续所有跨服务的调用上下文(如HTTP头、消息队列属性)中。每个服务在记录日志时,都必须包含此Trace ID。这样,在日志服务中通过一个ID即可拉取出该请求的完整执行路径。

- 结构化日志记录:摒弃难以解析的纯文本日志,采用结构化格式(如JSON)。每条日志应作为一条包含明确字段的记录,例如:

timestamp,level,service<em>name,trace</em>id,span<em>id,user</em>id,event,message,error_stack等。这使日志服务能够高效地进行字段级别的过滤、聚合和统计,例如:“快速找出所有包含某个错误码且来自‘支付服务’的日志”。

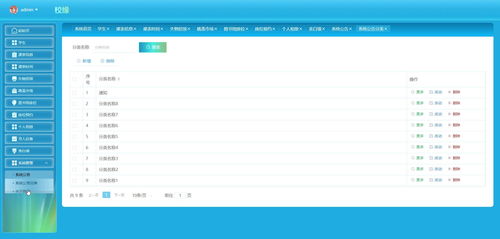

- 利用聚合与可视化发现异常:日志服务不仅是日志搜索引擎,更是数据分析平台。通过构建仪表盘,实时监控关键指标,如:各服务的错误日志率、特定接口的延迟百分位数、不同用户群体的行为模式对比等。异常的尖峰或趋势变化往往是系统潜在问题的先兆,可以引导调试方向。

- 从“面”到“点”的排查流程:当收到告警或用户反馈时,典型的调试流程为:

- 定位范围:在日志服务中,根据大致时间、受影响的用户或服务,快速缩小范围。

- 关联分析:输入可疑的Trace ID,或通过错误信息反查关联的请求链路。查看该请求经过的每一个服务节点,其输入、输出、耗时和状态。

- 根因分析:对比异常请求与正常请求的日志差异。重点检查:

- 服务间调用:网络超时?返回错误码?数据不一致?

- 资源状态:数据库连接池耗尽?缓存命中率骤降?队列堆积?

- 业务逻辑:边界条件处理不当?并发冲突?依赖的外部API变化?

- 现场还原:结合日志中的上下文(请求参数、用户标识、环境变量),尽可能在测试环境复现问题。

三、最佳实践与工具协同

- 日志分级与采样:合理使用DEBUG、INFO、WARN、ERROR等级别。生产环境应谨慎输出DEBUG日志,或采用动态采样机制,避免数据洪流和成本激增。错误(ERROR)日志必须包含足够的上文,便于定位。

- 与度量指标和链路追踪联动:日志(Logs)、指标(Metrics)、追踪(Traces)是可观测性的三大支柱。它们应协同工作。例如,从指标图表发现延迟升高,随即通过追踪系统找到慢请求的Trace ID,最后用日志服务深入查看该请求在慢服务内部的详细执行日志和错误堆栈。

- 建立调试查询手册:团队应沉淀常见的、高效的查询语句或仪表盘,例如“查找过去10分钟所有因数据库连接失败导致的错误”,形成团队知识库,加速新成员的问题排查。

四、挑战与展望

尽管日志服务功能强大,挑战依然存在:海量日志的存储与检索成本、敏感信息的脱敏、跨地域日志的聚合延迟等。与AIOps的结合是一大趋势,通过机器学习自动从日志模式中检测异常、聚类相似问题、甚至预测故障,将把分布式系统的调试从被动响应推向主动预防。

在分布式系统的世界里,调试已从“登录服务器看日志文件”演变为“在日志服务平台进行数据驱动的高效侦查”。一个设计良好、规范使用的日志服务体系,不仅是问题排查的“黑匣子”,更是理解系统行为、保障稳定性的战略资产。

如若转载,请注明出处:http://www.shhuimaijichuang.com/product/20.html

更新时间:2026-04-22 04:22:42